Das Unternehmen aus der Sicht des Mainstreams

Universität Siegen, 2018

Dieser Text ist ein Auszug aus der Studie „Eine kritische Analyse an deutschen Hochschulen vorherrschender Einführungen in die Mikro- und Makroökonomie und plural-heterodoxe Alternativlehrbücher“ von Helge Peukert und Christian Rebhan. In dieser Studie werden vorherrschende mikro- und makroökonomische Lehrbücher an deutschen Hochschulen anhand der exemplarischen Beispiele der Einführungen Varians und Blanchard/Illings texthermeneutisch und nach vorheriger Entwicklung eines Kriterienkatalogs zum Mainstream und zur Heterodoxie untersucht.

Ergebnisse der Studie auf einen Blick:

- Vor allem die mikroökonomischen Lehrbücher stellen einseitig die positiven Wohlfahrtseffekte der im Kern stabilen „Konkurrenzwirtschaft“ in den Mittelpunkt.

- Ungleichheit, ökologische und sozialpolitische Aspekte spielen kaum eine Rolle, staatliche Wirtschaftspolitik und z.B. die gewerkschaftliche Interessenvertretung der Arbeitnehmer werden einseitig negativ behandelt.

- Auch nach der Finanzkrise wird ein Ansatz eher effizienter Finanzmärkte vertreten. Entsprechend zurückhaltend fallen die Reformvorschläge aus.

- Die Studierenden lernen nur sehr wenige und ziemlich marktfreundliche Denkschulen kennen. Ökologische, postkeynesianische, sozioökonomische u.a. Ansätze werden nicht einbezogen.

Das Unternehmen aus der Sicht des Mainstreams: Gewinnmaximierung, Kostenminimierung, Kostenkurven und das Marktangebot

In Kapitel 20 von Varians „Grundzüge der Mikroökonomik“ über de Gewinnmaximierung (NK) wird von Konkurrenzmärkten ausgegangen und sich dementsprechend „das Unternehmen konstanten Preisen für seine Inputs und Outputs gegenübersieht“ (V, S. 403). Bei den Kosten finde eine Bewertung zu Marktpreisen statt (M4). In diesem Szenario wird die reale Welt mit einflussreichen Megacorps wie Google, Facebook und Amazon verlassen (zum kontrastiven Vergleich siehe Earl 1995, Kapitel 11 „Economics and corporate strategy and structure“, in dem es um realistische Strategien und Verhaltensweisen von Großunternehmen, teilweise unter Verwendung von Erkenntnissen aus der Neuen Institutionenökonomie geht).

Es ist darauf hinzuweisen, dass nicht nur im IT-Bereich und nicht nur in den USA, sondern in allen Industrieländern die Machtkonzentration in allen großen Wirtschaftszweigen in den letzten Jahrzehnten deutlich zugenommen hat, worauf von einigen Mainstreamökonom_innen auch die gesunkene Lohnquote zurückgeführt und eine deutliche Schwächung des Wettbewerbs festgestellt wird. Lasches Wettbewerbsrecht, Digitalisierung, Globalisierung und Netzwerkeffekte ließen Super-Firmen entstehen, die ihre Waren und Dienstleistungen weit über Herstellungskosten verkaufen und einen satten Preisaufschlag durchsetzen können. Vor allem in den USA ist dieser Trend in der Industrie, bei Dienstleistungen und Finanzen, im Einzel- und Großhandel, bei Versorgern und Transportunternehmen festzustellen (siehe zu dieser in der Mainstreamökonomie angekommenen Debatte z.B. Autor 2017 und De Loecker/Eeckhout 2017).

Varian hingegen bietet hingegen das Beispiel einer Bäuerin, die Land besitzt und es zur Produktion verwendet (V, S. 404). Auf nur einer Seite unterscheidet er kursorisch Einzelfirmen, Personen- und Kapitalgesellschaften. Einen großen Unterschied macht dies nicht aus, denn trotz der Trennung von Eigentum und Kontrolle bei Letzteren müssen die Eigentümer „ein Ziel definieren, dem die Manager bei der Leitung des Unternehmens zu folgen haben“ (V, S. 405). Da Gewinnmaximierung als einzig vernünftiges Ziel angegeben wird, ist es anscheinend unerheblich, um welche Unternehmensform es sich handelt. Gemäß dem Prinzip der Selbstverständlichkeit bestehender Strukturen (M10) und des konsequenten methodischen Individualismus (M2) heißt es lapidar: „In einer kapitalistischen Wirtschaft befinden sich die Unternehmen im Besitz von Individuen. Die Unternehmungen sind nur rechtliche Einheiten; letztlich sind es die Eigentümer der Unternehmung, die für das Verhalten der Unternehmung verantwortlich sind und für dieses Verhalten auch die Belohnung ernten oder die Kosten tragen“ (V, S. 404-405). Angesichts des nicht unrealistischen Principal-Agent-Ansatzes und nach der Finanzkrise wirken solche Allgemeinaussagen angesichts der mangelhaften Haftung durch Besitzer und CEOs und deren Verfolgen eigener Interessen viel zu vereinfachend.

„Maximierung des Wertes am Aktienmarkt bietet eine klare Zielfunktion für das Unternehmen in nahezu jedem ökonomischen Umfeld“ (V, S. 407). Doch man wolle sich auf einen einzigen sicheren Output und eine einzige Zeitperiode beschränken. Auch wird eine Annahme vorausgesetzt, die an Realitätsferne kaum zu überbieten ist: „Nehmen wir eine Welt mit vollständiger Sicherheit an, in welcher der Strom der zukünftigen Gewinne eines Unternehmens allgemein bekannt ist“ (V, S. 406). Es werden dann wie üblich fixe und variable Faktoren, die kurzfristige und langfristige Gewinnmaximierung, inverse Faktornachfragekurven und bekundete Gewinnerzielung erläutert (NK).

Interessant sind seine Ausführungen zu Gewinnmaximierung und Skalenerträgen (siehe den fairen Überblick zur Skalenertragsdebatte bei Zamagni 1987, S. 280-285). Er fragt, was wohl passiere, wenn konstante Skalenerträge vorlägen und ein Unternehmen im Gleichgewicht positive Gewinne erziele. Es ist etwas unklar, was der Gleichgewichtsbegriff hier bedeuten soll. Die Markträumung kann es schlecht sein, denn er meint, bei positiven Gewinnen würden die Unternehmen ihren Output und dementsprechend ihre Gewinne gerne verdoppeln. „Das widerspricht jedoch der Annahme, dass die ursprüngliche Entscheidung Gewinn maximierend war! […] (W)enn das ursprüngliche Gewinnniveau Null wäre, hätten wir kein Problem: Zweimal Null ist noch immer Null. Dieses Argument zeigt, dass das bei Wettbewerb einzig vernünftige langfristige Gewinnniveau eines Unternehmens, das konstante Skalenerträge für alle Outputniveaus aufweist, ein Gewinn von Null ist“ (V, S. 415).

Diese, der Realität völlig widerspreche (siehe die Berechnungen der mark-ups bei Loecker/Eeckhout 2017) und verdrehte Scheinargumentation folgt natürlich aus den surrealistischen Annahmen vollkommener Voraussicht (Unternehmen wissen von vornherein, ob und in welcher Höhe ein Produkt Absatz findet) und der Unterstellung von Konkurrenzmärkten, bei denen die Unternehmen so klein sind, dass ihre Produktion die Inputpreise nicht beeinflussen, sie sich nicht einer fallenden Nachfragekurve gegenübersehen usw. So müssen dann schließlich doch auch die üblicher Weise in LB bemühten Management- und Koordinationsprobleme bei sehr großen Unternehmen herhalten, um halbwegs plausibel eine Expansionsgrenze begründen zu können (V, S. 415; siehe Zamagni 1987, S. 268 zu Schwächen dieser Argumentation).

Es könnte ggf. Quasi-Monopolisten geben, aber dann läge kein Wettbewerb mehr vor und Gewinnmaximierung bei Konkurrenz wäre nicht mehr gegeben. Das ist schon richtig, aber kann man diese reale Möglichkeit ausschließen, weil sie gerade nicht ins Modell passt? Sehr richtig bemerkt er, dass bei positiven Gewinnen jedes andere Unternehmen seinen Output ausweiten könnte und dies sicherlich Preise und Gewinne drücken würde. Das stimmt, wenn man realitätsfern annimmt, alle Unternehmen könnten das Gut in gleicher Qualität aus dem Stand heraus produzieren, sie hätten keine Probleme, hierfür Kredite zu erhalten und es gäbe keine Markenbindung. Selbst im Falle von Nullgewinnen verschwindet die Frage zusätzlicher Unternehmen nicht, da annahmegemäß auch bei Nullgewinnen ein durchschnittlicher Unternehmerlohn gemäß dem Prinzip der Opportunitätskosten gezahlt wird.

Sollte es dann zu einer Zunahme von Unternehmen kommen (warum nicht?), würde dies sicher auf die Preise drücken. Immer dann, wenn man über die in der Mikroökonomie stilisierten „Konkurrenzmärkte“ jenseits des Gleichgewichts und mit dynamischen (Anpassungs-)Prozessen nachdenkt, gerät man in ein nebulöses Dickicht, dessen Beliebigkeiten und Widersprüche im Gegensatz zur beanspruchten exakten Wissenschaft stehen. Die Hinwegargumentation von Gewinnen bei Varian auf kaum präzise definierten und daher den Eindruck der Üblichkeit erweckenden „Konkurrenzmärkten“ macht zumindest einen unseriösen Eindruck.

Im abschließenden Beispiel geht es um Bauern, die auf das Entfallen von subventionierenden Preisstützungen nicht mit einer Ausweitung des Tierbestandes zwecks Kompensation reagieren würden, da ihre Mehrproduktion von Milch natürlich zu einem Rückgang des Outputpreises führe und die Mehrproduktion daher nicht eintreten würde. Dies setzt voraus, dass die Bauern ihre neu angeschafften Kühe schnell wiederverkaufen oder ohne größere Verluste schlachten lassen können; falls nicht, könnten sie den neuen Viehbestand als versunkene Kosten betrachten und es käme zu einem Überangebot. Da Varians Bauern jedoch vorausschauend sind, kommt es laut LB erst gar nicht zu einem Überangebot (M4, M12), was aber tatsächlich nach der jüngsten Freigabe des Milchmarktes in der EU der Fall ist.

In Kapitel 21 über Kostenminimierung zeigen sich in Abbildung 21.1 (V, S. 427) die theoriestrategischen Vorteile der Annahmen der Monotonie und Konvexität. Wie bei der Indifferenzkurvenanalyse gibt es dann nämlich bei zwei Inputfaktoren einen und nur einen optimalen Kombinationspunkt zur Kostenminimierung. Auch Kapitel 22 über Kostenkurven folgt der Standarddarstellung mit Durchschnitts- und Grenzkosten (NK), nur bei z.B. Kostenkurven bei Online-Auktionen und im Fall zweier Fabriken ergänzt Varian etwas den traditionellen Kanon. Wie selbstverständlich wird hier angenommen, dass die Faktorpreise bei verschiedenen Outputniveaus konstant bleiben (V, S. 441).

Mit bereits bekannten „Argumenten“ wird die zunächst fallende und dann ansteigende Durchschnittskostenkurve vorgestellt (NK). Der fallende Teil ist nötig, da steigende Kostenkurven über den gesamten Verlauf zu keinem Gleichgewicht führen würden, weil der Wettbewerb tendenziell unendlich kleine und unendlich viele Unternehmen hervorbringen könnte. Anfänglich schlagen laut LB die Fixkosten zu Buche, später überkompensiert durch den Anstieg der Durchschnittskosten. Jetzt wird nicht mehr ein Faktor variiert, sondern die variablen Kosten, aber immerhin blieben die Fixkosten als konstanter Faktor. „Wenn jedoch die Kapazität des Gebäudes erreicht wird, werden die Kosten steil ansteigen“ (V, S. 442; hier sei nur auf die vielen Einwände dieses Ansatzes anhand von Bumas 1999, Kapitel 6 über Kostenfunktionen hingewiesen; siehe auch den Diskussionsüberblick bei Shaik 2016, S. 151-164.). Warum hat der Unternehmer das nicht vorhergesehen und gleich ein größeres Gebäude gebaut, hat er doch sonst den vollkommenen Marktüberblick? Bei Annahme konstanter Faktorkosten: Warum wird überhaupt in Betracht gezogen, über die optimale Kapazität hinaus die Arbeit in einem Gebäude bestimmter Größe zu erhöhen und nicht ein weiteres Gebäude anzumieten? Man muss annehmen, dass hier an die Stelle der logischen Zeit die historische Zeit und begrenzte Voraussicht tritt und das zusätzliche Mieten eines Gebäudes in der kurzen Frist nicht so schnell erfolgen kann (M6; zu den gravierenden Unterschieden zwischen einem hypothetisch-deduktiven und einem historisch-deduktiven Vorgehen siehe Bresser-Pereira 2009).

Durch die U-förmige Durchschnittskostenkurve ergibt sich der zwangsläufige Verlauf der erst sinkenden und dann ansteigenden Grenzkostenkurve als Veränderungsrate (Kostenänderung geteilt durch Outputänderung. Diese Tatsache ist für die Behauptung einer natürlichen, auch gesamtwirtschaftlich effizientesten Unternehmensgröße sehr praktisch zur Legitimierung einer Konkurrenzwirtschaft (M5a; siehe Earl 1995, S. 208-213 zur Darstellung der ökonomischen Fachdiskussion zu vollkommenem Wettbewerb und der Skalenertragsdebatte.).

Es ist zu betonen, dass dieses Schneiden im Minimum aus der vorgängigen Annahme zum Durchschnittskostenkurvenverlauf zwangsläufig folgt und nicht auf Beobachtungen in der realen Welt beruht. Es müssen „in einem Bereich, in dem die durchschnittlichen variablen Kosten steigen, die Grenzkosten größer sein als die durchschnittlichen variablen Kosten - es sind ja gerade die höheren Grenzkosten, die den Durchschnitt nach oben drücken. Wir wissen daher, dass die Grenzkostenkurve links vom Minimum der Kurve der durchschnittlichen variablen Kosten unterhalb dieser Kurve liegen muss, rechts vom Minimum oberhalb. Das impliziert, dass die Grenzkostenkurve die Kurve der durchschnittlichen variablen Kosten in deren Minimum schneiden muss. Genau das gleiche gilt für die Durchschnittskostenkurve“ (V, S. 444).

Es ist nicht recht ersichtlich, wie seine unkritische Wiedergabe der U-förmigen langfristigen Kostenkurve als Umhüllende der kurzfristigen Kostenkurven mit seinen früheren Aussagen zu konstanten Skalenerträgen als Normallfall zusammenpassen (V, S. 454 versus S. 397). Zamagni (1987, S. 322) bietet ein realistischeres Schaubild mit langfristig konstanten Kosten. „The long-run equilibrium price is determined exclusively by the state of technology and prices of inputs, i.e. by cost conditions and not by demand conditions. The neoclassical paradigm of scarcity, according to which the equilibrium price is determined by the ´Marshallian scissors´, is not applicable here“ (1987, S. 322). Varian nimmt lieber einen Widerspruch in seinem LB hin, als Zugeständnisse hinsichtlich der Relevanz und den Grenzen der Neoklassik zu machen.

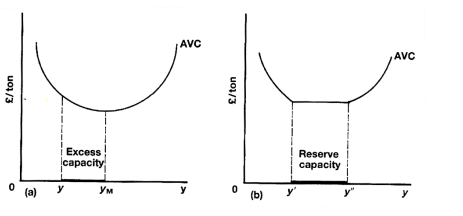

Untersuchungen von realen Kostenkurven stimmen nur in sehr seltenen Fällen mit dem hier konstruierten Normalfall überein. An dieser Stelle soll kurz auf eine empirisch oft bestätigte Darstellung hingewiesen werden, bei der davon ausgegangen wird, dass Unternehmen eine gewisse Flexibilität hinsichtlich ihrer Produktionskapazitäten haben wollen, um saisonale oder zyklische Fluktuationen auszugleichen. Die Produktionskapazitäten sind dementsprechend höher als die durchschnittlich erwarteten Verkaufszahlen.

Diese Reserveproduktionskapazitäten liegen nach empirischen Erhebungen meist in einem Bereich konstanter Durchschnittskosten und der erwartete Auslastungsgrad zwischen 2/3 und ¾ der Produktionskapazitäten. Dieser Ansatz unterscheidet sich vom U-förmigen Kostenkurvenverlauf der Mikroökonomie, bei dem angenommen wird, dass jedes Unternehmen nur bei einem und nur einem Output optimal produzieren kann.

Durchschnittskostenkurven mit Reservekapazität

Quelle: Zamagni 1987, S. 278 (dort findet sich auch die entsprechende Belegliteratur).

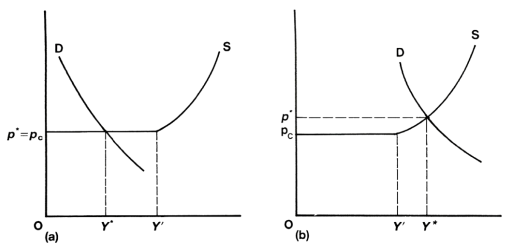

Für das kurzfristige Gleichgewicht auf einem Markt kann dies bei konstanten Kosten im relevanten Bereich zu folgenden Konstellationen führen:

Kurzfristige Gleichgewichte bei konstanten Kostenkurvenbereichen

Quelle: Zamagni 1987, S. 317.

Bei einer Zunahme der Nachfrage kann es demnach zu einem Preisanstieg kommen, dies muss aber nicht so sein und hängt vom Auslastungsgrad des Unternehmens ab, der bei Varian nicht berücksichtigt wird und er implizit einen unrealistischen Auslastungsgrad von 100 Prozent annimmt.

Mit Earl sei noch auf weitere grundsätzliche Probleme des Ansatzes zu den Kostenkurven hingewiesen. Zunächst soll die Anwendung des Opportunitätskostenprinzips auf die Kostenkurven in Augenschein genommen werden. Gemäß dem objektivistischen Kostenansatz der LB stellt die durchschnittliche Gesamtkostenkurve nicht die Opportunitätskosten, sondern die faktischen finanziellen Auslagen des Unternehmens dar, d.h. reale Kosten und nicht auf Erwartungen basierende, entgangene Möglichkeiten. Earl zitiert Littlechild: Die relevanten Produktionskosten sind „not the money outlay but the value of some alternative foregone use and this alternative is not ´given´ but exists only in the mind of the manager(s). Two managers with different knowledge about available alternatives, or different views about the future, will associate different costs with the very same output. Since the correctness of beliefs about the future cannot be established objectively (at the time), neither can be said to be wrong - each is right given his beliefs“ (Earl 1995, S. 157). Dies läuft dem objektivistischen Kostenansatz der LB entgegen, obwohl an anderer Stelle das Opportunitätskostenprinzip vertreten wird (z.B. V, 220), ohne dass auf diese Unverträglichkeit hingewiesen würde.

Der objektivistische Ansatz nimmt auch an, dass alle Technologien bekannt sind und sich genau und explizit beschreiben lassen. Earl (1995, S. 167) zitiert Polanyi und erwähnt Nelson und Winter, die auf die Bedeutung von implizitem, nicht formal und ausdrücklich beschreibbarem Wissen hinweisen, dass sich nur durch den aktiven Vollzug der Tätigkeiten lernen und nachvollziehen lässt. Earls Kapitel 7 über Produktionsmethoden und Produktivität (1995, S. 156-202) stellt neben der neoklassischen Variante und ihren Schwächen auch Lernkurven, technischen Wandel, die X-Effizienz Leibensteins, u.a. länderspezifische Unternehmenskulturen, die behavioral theory of the firm usw. auch anhand vieler Beispielfälle vor (zu Marshalls komplex-institutionellen Ansatz siehe die S, 204-208). Blättert man zum Vergleich Varian oder auch Pindyck/Rubinfeld (2015) durch, fällt deren Abstraktheit und Abgehobenheit vom realen Wirtschafsleben und die völlige Ausblendung vieler Ergebnisse und Überlegungen selbst aus dem Lager des Mainstreams auf. Der objektivistische Ansatz gerät auch in ernsthafte Probleme, wenn man Transaktionskosten berücksichtigt.

„Difficulties in separating the two types of cost arise wherever transaction costs affect production costs or production costs affect transaction costs. An example of the former would be where, as a result of spending more time searching for and evaluating potential employees, the firm ended up with employees who were more professionally capable and committed, more motivated to work without supervision, and who thus produced more for a given wage; or where, as a result of trying to economize on expenditure on managers by giving workers more responsibility over issues such as quality control, output either went up or down for a given employment of line workers. An example of the latter would be where investment in more specialized machinery and tools reduced the incidence of breakdowns and lapses of quality that managers might otherwise be needed to sort out. Once this interdependence is recognized, one can readily see very different strategies of how a firm or public service agency might minimize costs of meeting particular objectives“ (Earl 1995, S. 158).

So könne man Arbeitnehmer z.B. besser bezahlen oder stärker überwachen. Earl weist hier auf die in den LB völlig vernachlässigte Tatsache hin, dass es im realen Leben nicht nur um einen einfachen optimalen Mix der Produktionsfaktoren zur Outputgenerierung geht.

Kapitel 23 geht auf das Angebot der Unternehmen ein, das unter Bedingungen der vollkommenen Konkurrenz untersucht werden soll. Als Begründung wird angegeben, es handele sich hierbei um das „einfachste Marktverhältnis“ (V, S. 460; NK). Es ist nicht einzusehen, warum es ´einfacher´ sein soll als das der monopolistischen Konkurrenz oder des Monopols. Eine Abgrenzung zu den ansonsten im LB ubiquitären „Konkurrenzmärkten“ findet nicht statt. Vollkommene Konkurrenz sei auch eine gute Ausgangs- und Vergleichsbasis für viele andere Marktkonstellationen. Sie wird endlich präzise gekennzeichnet durch Preisnehmerschaft, identische Produkte und viele kleine Unternehmen, für die angesichts der bisherigen Normalkostenverläufe die Regel Preis = Grenzkosten abgeleitet wird.

Er gibt ein Beispiel, wieder einmal aus der Landwirtschaft, die ganze zwei Prozent des BIP in Industrieländern ausmacht. Es gäbe tausende Bauern, die Weizen anbauen und den Preis als von ihrem Angebot unabhängig ansehen. Varian versucht, den Geltungsbereich der vollkommenen Konkurrenz soweit wie möglich auszuweiten, selbst bei drei oder vier Unternehmen am Markt könnte ggf. jede Unternehmung die Preise der Anderen als gegeben unterstellen. Später wird allerdings bemerkt, die These, „dass sich eine kleine Zahl von Unternehmungen als vollkommene Konkurrenten verhalten wird, ist wahrscheinlich auch eine schlechte Näherung!“ (V, S. 485).

Varian desorientiert den Leser weiter, da er kurz darauf meint, wenn ein Unternehmen „zum Marktpreis anbietet, kann es jede beliebige Menge verkaufen“ (V, S. 461), was wohl nicht bei vier Unternehmen am Markt zutreffen dürfte. Dieses Vorgehen dient wohl theoriestrategisch dazu, zwar einerseits die restriktiven Bedingungen der vollkommenen Konkurrenz zu erwähnen, andererseits aber behaupten zu können, dass sie die vernünftige Vergleichsbasis für viele andere Situationen sei.

Auch wirft Abbildung 23.1 (V, S. 462), in der die Nachfragekurve eines Unternehmens und die Gesamtnachfrage in einer Abbildung untergebracht werden, Fragen auf. Man weiß nicht so recht, was der horizontale Bereich der Nachfragekurve des Einzelunternehmens bedeuten soll, da nur erklärt wird, er sei horizontal, weil das Angebot des Unternehmens sehr klein sei. Ist dieser Teil der Kurve also rein fiktional, da er de facto nie von einem Unternehmen realisiert wird? Diese Frage ist natürlich auch Varian bewusst, deshalb fügt er hinzu, das Schaubild gelte auch für nur zwei Unternehmen, von denen eines unbedingt auf einem fixen Preis bestehe und sich dann das andere Unternehmen der Nachfrage in der gerade behandelten Abbildung gegenübersehe. Einer solchen, seltenen (und unter den bisherigen Maximierungsannahmen völlig unwahrscheinlichen) Konstellation entspricht die Abbildung tatsächlich, sie hat aber ansonsten nichts mit den Annahmen der vollkommenen Konkurrenz zu tun. Nur nebenbei sei bemerkt, dass sich bei einem nicht ausgeschlossenen Zuströmen neuer Anbieter die gesamte Marktangebotskurve nach rechts verschiebt und sich ein neuer Gleichgewichtspreis ergeben muss. Zwar ist unter den hiesigen Annahmen für den Einzelanbieter die Nachfrage weiterhin horizontal, aber bei einem anderen Preis.

Endgültig verwirrend ist die folgende Aussage, „dass bei vielen kleinen Unternehmungen auf einem Markt jede einzelne sich einer Nachfragekurve gegenübersieht, die im Wesentlichen flach ist“ (V, S. 462). Man hätte gerne eine Abbildung, in der dargestellt wird, wie eine ´im Wesentlichen flache Nachfragekurve´ aussieht. In seinem Ausnahmefall (V, S. 464-465) eines doppelten Schneidens der Grenzkostenkurve bei einem bestimmten Preis gibt es wie üblich überhaupt keine Nachfragerestriktion. Das angebotene realwirtschaftliche Beispiel (V, S. 466-467) des raffinierten, strategischen Vorgehens von Microsoft zur Erlangung der Marktdominanz (Lizenzgebühren, die abhängig von erzeugten und nicht installierten Betriebssystemen sind) passt überhaupt nicht in den Rahmen der ansonsten rein mechanisch abgeleiteten Angebotskurve. Man weiß nicht, wofür es im LB ein Beispiel sein soll.

Die folgende langfristige ähnelt der kurzfristigen Angebotskurve, obwohl bei ihr alle Faktoren variabel sind (V, S. 472-474). Sie ist nur elastischer als die kurzfristige Angebotskurve. Aber warum steigt sie an, da doch das Argument für ihren aufsteigenden Verlauf darin bestand, dass es fixe Faktoren gibt und die Faktorpreise doch wohl weiterhin als konstant angenommen werden?

Am Ende des Kapitels kommt Varian wieder einmal auf die „besonders interessante Situation“ (V, S. 474) langfristig konstanter Durchschnittskosten zurück, bei der die langfristige Grenzkosten- mit der langfristigen Durchschnittskostenkurve übereinstimmt und horizontal verläuft (V, S. 475). Diese, an früherer Stelle von Varian für typisch gehaltene Situation konstanter Skalenerträge (V, S. 397) hat natürlich zwei Schönheitsfehler, die Varian den Studierenden vorenthält: Der gewinnmaximale Output kann nicht bestimmt werden und es lässt sich keine Aussage darüber treffen, wie viele Unternehmen sich auf dem Markt tummeln. Sollte es sich um ein enges Oligopol handeln, kämen Überlegungen zu marktbeherrschendem Verhalten und seiner Begrenzung ins Spiel.

Kapitel 24 geht zum Marktangebot einer Branche über. Im kurzfristigen Branchengleichgewicht kann es Unternehmen geben, die Gewinne erzielen und Varian unterscheidet drei Firmen, eins mit Nullgewinn, eins mit Verlusten und eins mit positivem Gewinn. Dies widerspricht der Annahme vollkommener Voraussicht, die an anderer Stelle bei der Analyse von Konkurrenzmärkten vorausgesetzt wurde. Es wird ferner die Annahme außer Kraft gesetzt, dass in der komparativen Statik gleiche Produktionstechnologien vorliegen. Auch hat die Durchmischung des Marktes hinsichtlich der Unternehmen in Bezug auf Gewinne oder Verluste anscheinend keinen Einfluss auf das sich schließlich einstellende Marktgleichgewicht mit Nullgewinn.

Wenn es z.B. sehr viele Unternehmen mit Verlusten gab und dementsprechend viele Arbeitskräfte freigesetzt werden, könnte dies doch einen Anker für niedrigere Löhne setzen, sodass die übriggebliebenen Unternehmen die Arbeitslosen zu einem günstigeren Lohn einstellen können. Werden vorausschauende, maximierende Akteure angenommen, fragt es sich, warum sie nicht von vornherein die kostengünstige Variante wählten, da es bei vollkommener Konkurrenz annahmegemäß kein Nichtwissen gibt.

Es wird auf jeden Fall unterstellt, dass das Gleichgewicht hinsichtlich Preis, Angebot und Nachfrage am Ende des Tages immer gleich sein wird, unabhängig davon, wie der Weg und Preispfad dorthin aussah. Über die Anpassungsprozesse und die sie begleitenden Vorgänge kann man mit der komparativen Statik eigentlich überhaupt keine Aussagen treffen. So hieß es gleich zu Beginn des LB zum Wohnungsmarktgleichgewicht konsequenter Weise, „dieser Gleichgewichtspreis interessiert uns, nicht jedoch wie der Markt zu diesem Gleichgewicht kommt“ (V, S. 3).

Natürlich stimmt die Überlegung, „(w)enn ein Unternehmen andererseits Gewinne erzielt, würden wir Eintritte in die Branche erwarten“ (V, S. 481). Eine dynamische, z.B. österreichische Marktprozesstheorie würde hier ansetzen und mit Schumpeter Wettbewerb als Prozess schöpferischer Zerstörung verstehen, der sich nicht (nur) auf Preis- und Mengenanpassungen beschränkt, sondern vielmehr auf die Erfindung und Einführung neuer Güter, Technologien oder Produktionsprozesse, die zu Ungleichgewichten führen und evolutionäre Marktentwicklungen eine unendliche Sequenz von Bewegungen und Gegenbewegungen auslösen (zu den Unterschieden innerhalb der Austrians siehe Yu/Shiu 2011).

Auch viele klassische politische Ökonom_innen wie Smith und Marx vertraten einen dynamischen Marktprozessansatz, der in den LB nicht vorkommt/Eatwell 1982 und das LB aus klassischer Perspektive von Robinson/Eatwell 1980; siehe auch den Vergleich zwischen Klassik, Neoklassik und Schumpeter bei Zamagni 1987, S. 294-297 und bei Earl 1995, S. 249-255, zur Bepreisung neuer „Schumepter“-Produkte auch anhand von Beispielen). Varoufakis (1998, Kapitel 6) beschreibt die Geschichte der Wettbewerbskonzepte seit der Klassik. „While classicists saw production as a social process involving simultaneously power games, exchange, cajoling, threats, even exploitation, neoclassicists pictured production as a type of pure exchange. And where the classicists tried to understand markets by painting an accurate and wholistic picture of the markets they observed, the neoclassicists tried to do the same by painting a model of ideal markets one at the time“ (1998, S. 165).

Im LB wird aber eine realitätsleugnende Leichtigkeit der Anpassung in der langen Frist ohne fixe Faktoren angenommen, sofern keine relevanten Eintrittsbarrieren bestehen, wobei sich Varian nur Lizenzen, Konzessionen und rechtliche Beschränkungen (V, S. 481) und nicht z.B. steigende Skalenerträge als Eintrittsbarrieren für Newcomer vorstellen kann. In der Realität häufiger vorkommende steigende Skalenerträge spielen bei Varian sicher auch deshalb praktisch keine Rolle, weil sie die schöne Harmonie auf Wettbewerbsmärkten stören, was Varian sehr weit hinten im Buch, in einem zu den Randkapiteln gehörenden Abschnitt erwähnt.

„Derartige Nicht-Konvexitäten stellen große Schwierigkeiten für das Funktionieren von Konkurrenzmärkten dar. Auf einem Konkurrenzmarkt achten Konsumenten und Unternehmen nur auf einen Zahlenvektor - die Marktpreise -, um ihre Konsum- und Produktionsentscheidungen zu treffen […] Wenn aber die Technologie und/oder die Präferenzen nicht konvex sind, dann vermitteln die Preise nicht die gesamte, zur Wahl einer effizienten Allokation erforderliche Information. Informationen über die Steigungen der Produktionsfunktion und der Indifferenzkurven weiter entfernt vom derzeitigen Produktionsniveau sind ebenfalls erforderlich“ (V, S. 705).

Ob die Marktkräfte die hierfür erforderliche Weitsicht generieren, ist fraglich (Gefahr von lock-ins), auch wäre ein Auktionator bei steigenden Skalenerträgen vor eine wohl unmögliche Koordinationsaufgabe gestellt und Varian müsste sein harmonisches Narrativ der Konkurrenzmärkte relativieren und modifizieren.

Doch zurück zu Varians Standardökonomie. „Wenn ein Unternehmen langfristige Gewinne erzielt, so bedeutet das, dass jedermann auf diesen Markt gehen kann, die Faktoren erwirbt, und dieselbe Outputmenge zu denselben Kosten erzeugt“ (V, S. 481; NK). Wenn nun viele jedermanns auf den Markt strömen, was stellt sicher, dass es (unter den dabei unterstellten Annahmen) nicht zu einem Überangebot kommt? Schließlich liegen die Preise der folgenden Periode noch nicht vor. Die investitionswilligen Unternehmen können nicht wissen, wie andere potentielle Anbieter handeln werden und wie sich dies auf Preise und Mengen auswirken wird.

Dieses Koordinationsproblem wird in Richardson (1960) hervorragend umrissen, der entgegen den neoklassischen Annahmen „Marktunvollkommenheiten“ wie Preisrigiditäten, Tarifverträge, institutionelle Regelungen usw. als hilfreich zur Lösung des Koordinationsbedarfs hervorhebt. Sehr inhaltsreich diskutiert Earl (1995, S. 303-339) auch mit Beispielen, Bezügen zur Neuen Institutionenökonomie und einem Vergleich mit dem Arrow-Debreu-Modell die Fragestellung und den heterodoxen Lösungsweg Richardsons.

Anhand des Spinnwebtheorems kann leicht gezeigt werden, dass es von den Angebots- und Nachfrageelastizitäten abhängt, ob ein eventueller Annäherungsprozess zu einem (stabilen) Gleichgewicht führt, es zu einer stabilen Oszillation kommt oder zu einer explosiven Ungleichgewichtsentwicklung. Bumas, der auch die drei möglichen Verläufe abbildet, zitiert Daniel Suits Studie zum Schweinezyklus in den USA: „Eight price peaks can be shown in the nearly 30-year period shown […] This works out to an average of three to four years to cycle from high to low prices and back again. The relatively long period of this cobweb cycle reflects the time required for farmers to build up the herd of brood-sows […] and the additional time that must elapse after the sows are bred before mature hogs are ready for market“ (1999, S. 71). Bumas weist an gleicher Stelle darauf hin, dass der Erfinder der Theorie rationaler Erwartungen, John Muth, den englischen Schweinemarkt als Beleg seiner Annahme rationaler Vorhersicht anführte. Man sollte aus empirischen Einzelfällen nicht allzu forsch generalisieren.

Wenn aber die Akteure das Marktgeschehen annahmegemäß genau überblicken können, wieso konnten sie dies nicht schon vorher beim ursprünglichen Aufbau des fixen Faktors? Woher beziehen die zuströmenden Unternehmen die Arbeitskräfte? Bestand vorher Unterbeschäftigung oder müssen sie die Arbeitnehmer mit besonders hohen Löhnen weglocken?

All diese Fragen tauchen nicht auf, nur das Ergebnis steht fest: Der Schnittpunkt wird beim niedrigsten, mit nicht-negativen Gewinnen vereinbaren Preis liegen (V, S. 482), der schon im kurzfristigen Gleichgewicht feststand. In der Modellwelt Varians ändert sich auf dem betrachteten Markt in der langen Frist im Marktumfeld gar nichts. Eine solche Statik und ein solcher Stillstand erinnern eher an die Gegebenheiten Nordkoreas als an dynamisch-evolutive Marktökonomien.

Bei der Ableitung der langfristigen Angebotskurve nimmt „man typischerweise“ (V, S. 483) an, dass die Marktnachfrage fallend ist (NK). Auch ansonsten finden sich wieder unklare Angaben. Um eine Angebotskurve von Null zu erhalten, bedarf es einer „vernünftigen Anzahl“ von Unternehmen. Die Angebotskurve sollte „recht flach“ sein, „flach genug, um für sie eine Steigung von Null anzunehmen“ (V, S. 485). Bei einer „sinnvollen Anzahl“ kann sich der Gleichgewichtspreis nicht weit von den minimalen Durchschnittskosten entfernen“ (V, S. 485).

So präzise die Zeichnungen und Rechnungen Varians auch erscheinen, die realen Beschreibungen, hier der Anzahl der Unternehmen, bleiben doch recht fuzzy und schwammig. Varian unterstreicht noch einmal, dass eine exakte Duplizierung eines Unternehmens durch einen anderen möglich ist und es daher denselben Output auf dieselbe Art wie das bestehende Unternehmen erzeugen kann (V, S. 486).

Dies liefe dann auf eine langfristig horizontale Gesamtangebotskurve hinaus, die identisch mit den konstanten Skalenerträgen eines Einzelunternehmens sei. Dies mag die Studierenden irritieren, da doch vorher ein U-förmiger Verlauf der langfristig Umhüllenden des Einzelunternehmens vorgestellt wurde (V, S. 454). Die Probleme bei horizontalen Angebotskurven wurden schon erwähnt: Wie hoch ist der gewinnmaximale Output des einzelnen Unternehmens und wie viele Unternehmen gibt es?

Am Beispiel von Intel wies Varian schon auf den Unterschied zwischen einer Betriebsstätte und einem Unternehmen hin: Wenn ein Unternehmen fast alle Betriebsstätten besitzt und nicht wegen steigender Kostenverläufe gebremst wird, was bleibt von der Annahme des Konkurrenzgleichgewichts? Dann dürfte die folgende Unterstellung von Nullgewinnen (V, S. 488-489) hinfällig werden, da ein Quasi-Monopolist in der Lage sein dürfte, Gewinne zu realisieren. Auf genau einer Seite wird die These der Nullgewinne anhand des alltagsplausiblen Arguments unterbreitet, dass bei ihrem Vorliegen neue Akteure einströmen und die Gewinne zunichtemachen. Realistischer Weise kann man aber annehmen, dass es auch in der langen Frist unterschiedlich effiziente Firmen wie im folgenden Schaubild gibt:

Darstellung der Kosten- und Gewinnsituation unterschiedlich effizienter Firmen in der langen Frist

Quelle: Zamagni 1987, S. 325.

Für Firma B oder Firmengruppe B ergibt sich hier ein (Extra)Gewinn. „In most textbooks this rent is included in the long-run cost curves of the firms which benefit from it, with the result that the LAC [Long Run Average Cost] curves of both marginal and inframarginal firms appear to be equal. This is most often justified by stating that the managers´ rent, to the extent that it is an opportunity cost, should be considered as a component of production costs“ (Zamagni 1987, S. 325). Diese Sicht teilt auch Varian. Aber Zamagni argumentiert zu Recht, dass sie falsch ist.

„The rent in question depends on market demand. It plays no role in determining the equilibrium price, but it is determined by it. In other words, before knowing the size of this rent, we must first know the long-run equilibrium price which is in turn determined by the state of technology and demand conditions. To include the managers´ rent in cost curves is therefore to invert the order of causality of the relation in question. We cannot consider something which depends on demand conditions as a constituent element of costs“ (1987, S. 326).

Sollte sich nämlich die Marktnachfragekurve nach links verschieben, würden die Firmen deGruppe A gezwungen, den Markt zu verlassen und die Renten der Manager in Gruppe B verschwinden, ohne jegliche Veränderung der Kostenkurven. Schlüge man die Renten der Manager in Gruppe B den Kosten zu, wie in bestimmten Teilen der LB, so würde eine Nachfragesenkung nur zu einer Abnahme der produzierten Menge führen und nicht den Gleichgewichtspreis beeinflussen, was falsch wäre. „It is therefore untrue in a situation such as the above that long-run competitive equilibrium implies zero excess profits for all firms. The most efficient firms will make excess profits in the form of managers´ rent“ (1987, S. 326).

Durch das Opportunitätskostenprinzip wird es auch möglich, Gewinne dank Eintrittsbarrieren weg zu definieren. Konzessionen, Lizenzen, Talent oder rechtliche Hürden ermöglichen den Bezug von Renten, d.h. Gewinne, die aus einem quasi fixen Faktor resultieren (V, S. 490). Alle durch irgendwelche Eingangsbarrieren bedingten Gewinne werden dank des Opportunitätskostenarguments in Kosten umgewandelt. So wundert es nicht, dass sich Varian in einer Welt der Nullgewinne wähnen kann. Verschwinden dann auch die (bisher zu einem großen Teil im Ausland) angehäuften Gewinne Googles auf einen Schlag, da man die Lizenzen und den Markennamen auch verkaufen könnte?

Das Kapitel enthält noch einige Beispiele, bei denen gute Vorsätze von Seiten der Regierung ins Leere laufen oder kontraproduktive Wirkungen erzielen: Besteuerung von Gütern bei horizontaler Angebotskurve belastet nur die Konsumenten (bei einem Oligopol sähe dies möglicher Weise anders aus), Lohnerhöhungen der Taxifahrer in New York bleiben beim bestehenden Konzessionssystem wirkungslos, Ausschankkonzessionen für Alkohol finden regen Zuspruch bei den bisherigen Besitzern von Konzessionen, da diese ihnen nützen usw. Beschränkungen von Seiten der Politik liegen meistens im Interesse der alteingesessenen Unternehmen: „Die etablierten Unternehmungen in einer gesetzlich beschränkten Branche können sogar beträchtliche Ressourcen zur Aufrechterhaltung ihrer begünstigten Position aufwenden“ (V, S. 495; M5a).

Dies führe im Allgemeinen zu reiner sozialen Verschwendung, was durch das Beispiel des Subventionsprogramms für die US-Landwirtschaft veranschaulicht wird (V, S. 496-497). Es folgt das Beispiel der gescheiterten Politik der gespaltenen Erdölpreise in den 1970er Jahren, was nur zu einer Umverteilung von den inländischen Ölproduzenten zu den inländischen Raffinerien und nicht eine Ölpreissenkung bewirkt habe.

Die Moral der Beispiele lautet: Versuche gestaltender Regulierung führen zu Ungerechtigkeiten, sind meist wirkungslos und Resultat des Lobbyismus. Varian folgt hier über viele Seiten vollständig auf den Pfaden von Public Choice, ein Ansatz, der bei ihm in extremer Ausprägung ausschließlich die Nachteile staatlichen und öffentlichen Gestaltungsbemühens thematisiert. Nur beim Vergleich Kohlendioxidsteuer versus Zertifikathandel fällt er sein generelles Verdammungsurteil nicht und spricht sich aus politökonomischen Gründen für eine Steuerlösung aus, natürlich nicht ohne am Ende zu warnen: „Zweifellos würden Unternehmen versuchen, aus dem einen oder anderen Grund Ausnahmeregelungen von der Kohlendioxidsteuer zu erhalten“ (V, S. 505).